Di edge AI industriale si parla da anni. E nel 2026 qualcosa è cambiato: non è più un concetto astratto. I dispositivi ci sono, i modelli girano, i costi si sono abbassati. Eppure il 70% dei progetti Industry resta fermo alla fase pilota, secondo le stime di settore. E tra il demo che funziona sul banco e il sistema che regge tre turni su una linea vera, c’è un abisso.

Per l’edge AI: Cosa funziona, cosa no, quanto costa e da dove si parte.

Tre casi d’uso edge AI

Il mercato edge AI industriale vale circa 25 miliardi di dollari nel 2025 e cresce del 21,7% annuo. Ma i numeri aggregati dicono poco. Quello che conta è capire dove l’edge AI genera valore misurabile oggi in un contesto manifatturiero.

Visual inspection: controllo qualità in tempo reale

La computer vision è il caso d’uso più maturo. Telecamere + modelli di deep learning direttamente sulla linea, senza passare dal cloud. Il sistema ispeziona ogni pezzo, rileva difetti sotto il millimetro, e lo fa a velocità di linea. Risultati recenti parlano di riduzione dei difetti del 30% e latenza sotto i 10 ms. Siemens, per fare un esempio concreto, usa sensori Arm-based con modelli edge per ispezione visiva su linee di assemblaggio.

Per chi fa automazione industriale, questo è probabilmente il punto d’ingresso con il rapporto rischio/beneficio migliore.

Predictive maintenance: anticipare i guasti, non subirli

Sensori di vibrazione, temperatura e acustica che analizzano i dati localmente e prevedono i guasti 48–72 ore prima che accadano. Nell’industria pesante e chimica, i dati parlano di riduzione dei fermi imprevisti del 25–40% e allungamento della vita utile degli asset del 25%.

La differenza rispetto alla classica manutenzione programmata è che intervieni solo quando serve davvero. Rispetto al cloud-based: il modello gira sul dispositivo, non devi aspettare la risposta del server e funziona anche se la rete è giù. Per capire come si integra con i sensori IIoT, vale la pena approfondire il tema della sensor fusion.

Cobot e AMR: decisioni in millisecondi

Robot collaborativi e veicoli a guida autonoma (AMR) in magazzino o in produzione dipendono dall’inferenza locale per la navigazione, l’obstacle avoidance e il coordinamento. Non puoi mandare il frame video al cloud e aspettare la risposta: il cobot deve reagire in millisecondi. I sistemi con edge AI industriale riducono gli errori di picking del 35% nei magazzini con SKU variabili, e permettono di riconfigurare le linee senza fermo.

I limiti reali dell’Edge AI industriale: perché il 70% dei progetti si ferma al pilota

Ok, i casi d’uso funzionano. Ma allora perché così tanti progetti non arrivano in produzione? I motivi sono meno tecnologici di quanto si pensi.

Il deployment su scala è un altro mestiere

Far girare un modello su un dispositivo in laboratorio è una cosa. Farlo girare su 500 dispositivi distribuiti in 12 stabilimenti, con hardware diverso, connettività intermittente e reti OT segmentate, è un’altra. Le piattaforme di MLOps arrivano fino al packaging del modello. Poi ti trovi da solo. L’orchestrazione dei modelli all’edge industriale, l’aggiornamento OTA, il monitoring della drift, la gestione dell’hardware eterogeneo: tutto questo richiede competenze che nella maggior parte delle aziende manifatturiere non ci sono. Non ancora.

Potenza di calcolo vs. accuratezza del modello

Un dispositivo edge ha risorse limitate: poca RAM, poca potenza di calcolo, vincoli termici. Per far girare un modello su un microcontrollore con 16 KB di RAM (sì, esistono, e LiteRT Micro ci gira) serve quantizzazione, pruning, knowledge distillation. Ogni passaggio di compressione può erodere l’accuratezza. Il trade-off è reale e va calibrato caso per caso. Un modello di ispezione visiva che perde il 2% di accuratezza dopo la quantizzazione può essere accettabile. Uno che controlla dispositivi medicali, no.

Chi progetta sistemi embedded conosce bene questo equilibrio.

Connettività e sicurezza: il punto dolente delle reti OT

Le reti industriali non sono reti IT. Segmentazione, firewall, protocolli legacy, connettività instabile in ambienti remoti o rumorosi dal punto di vista elettromagnetico. Ogni aggiornamento del modello deve passare per gateway, proxy, talvolta floppy disk virtuali. Scherzo. Ma neanche troppo. Il tema della cybersecurity edge AI è serio: ogni dispositivo connesso è una superficie d’attacco. Nel 2024 la backdoor Keyplug, nel 2025, gli attacchi alla logistica sono cresciuti del 61%. Un sistema edge AI che non prevede aggiornamenti sicuri e autenticazione forte è un rischio, non un vantaggio.

Da LLM a SLM: il cambio di paradigma per l’edge AI industriale

Gartner prevede che entro il 2027, le organizzazioni useranno modelli piccoli e task-specific tre volte di più rispetto ai modelli generalistici. All’edge, questo è già realtà.

I Small Language Model (SLM) ottimizzati per edge consumano una frazione dell’energia e del compute richiesti da un LLM, con accuratezza elevata per compiti specifici.

Un terminale a bordo macchina che traduce codici di errore in istruzioni di troubleshooting: on servono 70 miliardi di parametri per questo.

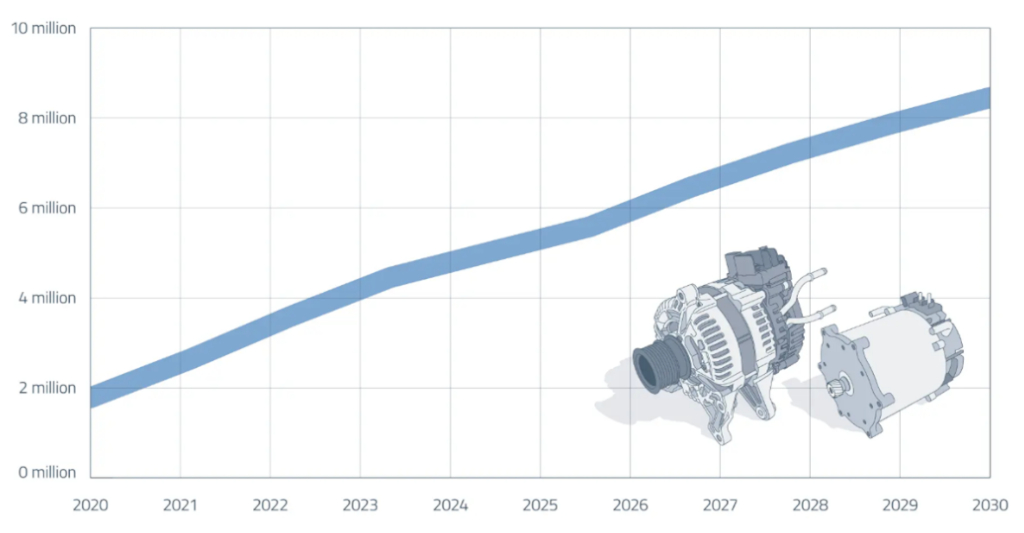

Il TinyML porta il concetto ancora più in basso: modelli di machine learning che girano su microcontrollori a bassissimo consumo. Fino a qualche anno fa era teoria. Nel 2026, TI ha acquisito Silicon Labs proprio per portare la piattaforma IoT Series 3 (10x le performance della generazione precedente) sulla sua produzione di wafer da 300mm. Quando un’azienda di quella scala acquisisce una piattaforma edge AI industriale e punta subito a ridurre il costo per unità, non sta scommettendo sul futuro: sta rispondendo a domanda già presente.

Per chi sviluppa su microcontrollori intelligenti per IoT, il framework LiteRT (ex TensorFlow Lite) con la variante Micro permette di fare inferenza su dispositivi ARM Cortex-M con 16 KB di RAM. Non è fantascienza. È un datasheet.

Hardware edge AI industriale nel 2026: cosa c’è sul mercato per l’industria

Il panorama hardware si è fatto più interessante. Ecco qualche riferimento concreto per orientarsi.

NVIDIA Jetson Orin resta il punto di riferimento per applicazioni che richiedono potenza (computer vision multi-stream, AMR). I moduli Hailo-8 e Hailo-10, montabili su slot M.2 in PC industriali rugged, permettono di aggiungere capacità AI a sistemi già installati senza sostituire l’hardware. La serie Qualcomm Dragonwing IQ9 offre fino a 100 TOPS con consumi da leader di settore, ed è in grado di far girare Llama2 da 13 miliardi di parametri a 12 token/secondo. Il tema di etica dell’IA nasce proprio qui: la responsabilità non può essere delegata completamente alla macchina, perché ogni modello è il risultato di scelte umane.

Il trend hardware del 2026 è la modularità. Un singolo box rugged che oggi fa data logging e domani fa ispezione visiva, cambiando solo il modulo AI. Per chi segue l’evoluzione dell’edge computing embedded, il cambiamento è tangibile.

Come passare dal pilota alla produzione: un approccio pratico

| Partire da un caso d’uso singolo, misurabile | Scegliere hardware modulare e aperto | Pianificare il lifecycle del modello, non solo il deployment | Coinvolgere OT e maintenance dall’inizio |

|---|---|---|---|

| La manutenzione predittiva su una macchina critica. Oppure la visual inspection su una linea con un alto tasso di scarto. Un obiettivo chiaro: ridurre i fermi del 10%, abbattere i difetti del 5%. Se il pilota non ha una metrica di successo, non saprà mai se ha funzionato. E non genererà il consenso interno per scalare. | Un box rugged con slot per acceleratore AI è un investimento che regge nel tempo. L’acceleratore cambia, il box resta. Evitare architetture chiuse che vincolano a un singolo vendor per hardware, software e modelli. Le piattaforme che supportano più framework (TensorFlow Lite, ONNX, PyTorch) e più OS danno più margine di manovra. | Un modello AI non è un firmware che installi e dimentichi. I dati cambiano, il processo evolve, il modello va riaddestrato. Serve un piano per l’aggiornamento OTA, il monitoring della drift, il rollback in caso di problemi. Se questo piano non esiste prima del go-live, si finisce con modelli stantii che peggiorano nel tempo e nessuno se ne accorge. | L’errore classico: l’IT o l’R&D costruisce il sistema, poi lo “consegna” alla produzione. Il risultato è un sistema che nessuno usa. Gli operatori di linea e i manutentori devono essere coinvolti dalla fase pilota, perché sono loro che sanno dove il processo si rompe e cosa serve davvero. Un sistema di embedded intelligence funziona solo se chi ci lavora ogni giorno lo capisce e ci crede. |

Cosa aspettarsi: edge AI industriale nella seconda metà del 2026

Dell prevede che la computer vision resterà il caso d’uso edge industriale AI dominante. Gartner dice che entro il 2030, metà delle soluzioni di supply chain management includerà AI agentiche. IDC stima che oltre il 40% dei manufacturer con sistemi di scheduling aggiornerà all’AI entro fine 2026. Il trend architetturale è l’ibrido edge-cloud: l’edge gestisce inferenza in tempo reale e decisioni critiche, il cloud fa training, analytics pesanti e storage storico. Le aziende che adottano questa architettura riportano risposte più rapide del 40% sulle operazioni e costi cloud ridotti del 30–50%.

Processare in locale, trasmettere solo i risultati, diventa una scelta economica oltre che tecnica. L’IoT device che si limita a spedire dati grezzi al cloud inizia a sembrare il terminale stupido di quest’epoca. L’edge AI industriale nel 2026 non è più una promessa. Ma non è nemmeno un plug-and-play.